Methoden & Software

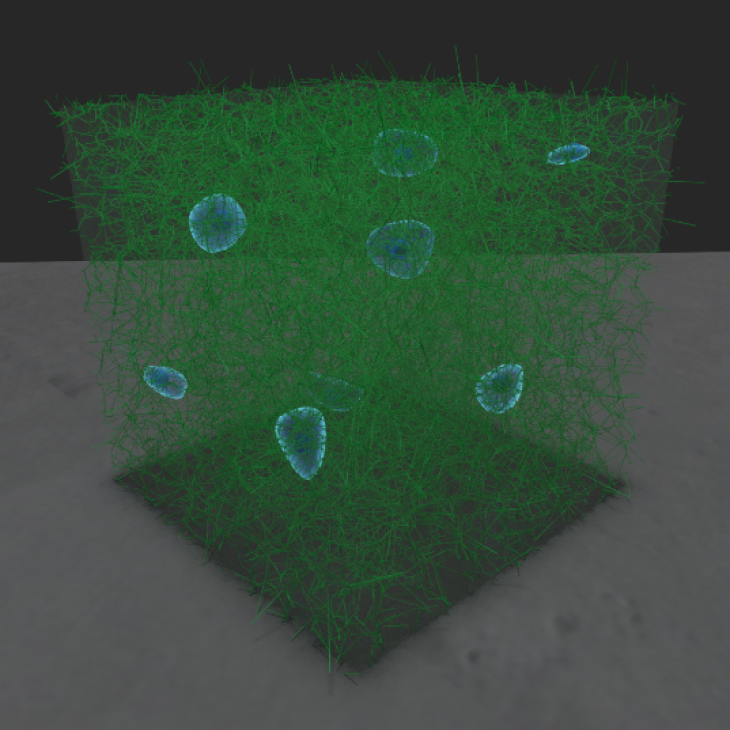

Bild: Hereon/N. Huber

Am Hereon werden für das JL VMD mehrere Softwaretools entwickelt. Der nichtkommerzielle hocheffiziente Multiphysik-Code 4C wird gemeinsam mit der TU München (TUM) und der Universität der Bundeswehr München entwickelt.

4C ermöglicht die effiziente Lösung von Problemen der Festkörpermechanik, Fluidmechanik, Skalartransport und gekoppelten Systemen. Insbesondere können Fluid-Struktur-Interaktionen, durchströmte poröse Medien, elektromechanische und weitere Probleme auf unterschiedlichen Diskretisierungen numerisch berechnet werden. Dabei kommen hauptsächlich Finite Elemente und Partikelmethoden zum Einsatz.

Während viele Fragestellungen bereits mit der bestehenden Implementierung behandelt werden können, besteht durch die modulare Struktur die Möglichkeit von Erweiterungen und zusätzlichen Kopplungen durch Anwender.

4C ist MPI parallelisiert und kann von der Workstation bis zu großen HPC-Systemen effizient genutzt werden. Um dies zu gewährleisten, wird 4C an langjährig erprobte parallele Gleichungslöser, u.a. die Bibliothek Trilinos vom Sandia National Lab in den USA, angebunden und nutzt deren aktuelle Entwicklungen. Auf der Skalierbarkeit des Codes liegt dabei besonderes Augenmerk.

Codes, die auf der numerischen Lösung physikalischer Gleichungen basieren, werden durch Methodenentwicklungen auf dem Gebiet des maschinellen Lernens ergänzt. Im Vordergrund stehen hier selbstoptimierende Architekturen, das Verschneiden von Simulationsdaten mit experimentellen Daten, sowie die Kopplung von daten-gestützten und theorie-gestützten Architekturen.

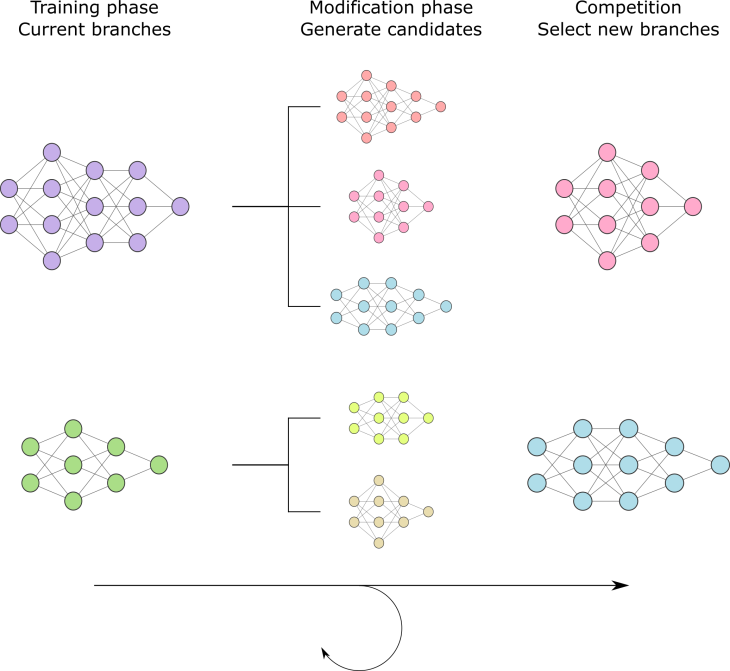

Bild: Hereon/E. Schiessler

Wir haben ein Framework für einen genetischen Architektursuchalgorithmus für neuronale Netze entwickelt, der die Optimierung der Netzwerkarchitektur mit dem eigentlichen Training des neuronalen Netzes kombiniert. Basierend auf mathematischen und statistischen Kriterien werden modifizierte Netzwerk-Versionen erzeugt, die in Konkurrenz zueinander stehen. Aus dem Pool aller solcher generierter Kandidaten werden Gewinner ausgewählt, diese erhalten weiteres Training. Der Prozess wird so lange wiederholt, bis ein vollständig entwickeltes, fertig trainiertes, finales Netzwerk entsteht.

Quelle: Elisabeth J. Schiessler, Roland C. Aydin et al., Neural network surgery: Combining training with topology optimization, Neural Networks, 2021

Publikation